这个必须顶啊,谢谢啊

5 个赞

感谢 ![]() ,在pot里用了一下,我这里似乎不能直连使用

,在pot里用了一下,我这里似乎不能直连使用

5 个赞

支持作者,谢谢分享

3 个赞

不是很清楚传统翻译模型面对大模型有什么优势

1 个赞

感谢大佬分享

2 个赞

感谢分享,请问支持最新的那个新一代大模型吗?

3 个赞

那留个记号 空了比较一下 ![]()

3 个赞

deeplx扔沉浸里面貌似可以做负载吧?翻译了下新闻首页,貌似就4000多没了,不过还好我每天50w

2 个赞

接口能否通过油猴调用

3 个赞

感谢大佬的福利,美滋滋

2 个赞

感谢大佬,速度嘎嘎快

3 个赞

太强了,感谢大佬!

15 个赞

你们觉得这个好用?我用起来比其他AI差远了

2 个赞

deepL 自家也可以上ai提升的啊,总不可能一成不变吧。

3 个赞

感谢,没想到自己账号已经三年多了

9 个赞

感谢大佬,对于日常轻量使用以足够 ![]()

3 个赞

感谢大佬分享,一天50w够用了~

1 个赞

感谢大佬分享

3 个赞

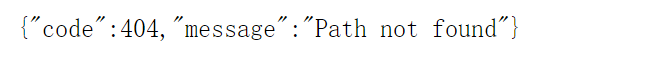

咨询一下, 为啥我的是

5 个赞

谢谢佬!!!

3 个赞