在2024年7月23日,Meta发布了最新的大语言模型——Llama 3.1。这款模型被称为迄今为止最强大的模型。我们来详细解析一下这款模型的特点和亮点。

主要特点

-

三种规模:

- Llama 3.1有三个版本:8B(80亿参数)、70B(700亿参数)和405B(4050亿参数)。这个多样性使得用户可以根据不同需求选择适合的模型版本。

-

开源承诺:

- Meta承诺继续提供开放可访问的AI。扎克伯格在一封信中详细说明了开源对开发者、Meta及全球的好处。这表明Meta不仅在技术上创新,同时也在社会责任上有所担当。

-

扩展上下文长度:

- 新的模型支持扩展上下文长度到128K。这意味着Llama 3.1能够处理更长的文本,并且在复杂对话和长文档理解方面表现更出色。

-

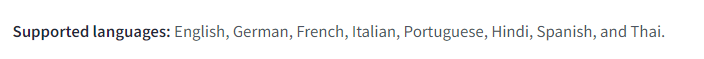

多语言支持:

- Llama 3.1支持八种语言,这让它成为一个真正全球化的工具,可以应用于多种语言环境中,为不同地区和文化背景的人们提供服务。

-

前沿级别的开源AI:

- 特别是Llama 3.1 405B,被誉为第一个前沿级别的开源AI模型。这不仅是技术上的突破,也是开源社区的一大进步,可能会引领新一波AI应用的发展潮流。

突出性能

- Llama 3.1 405B独树一帜:

- Llama 3.1 405B凭借其庞大的参数量和先进的架构,成为同类模型中的佼佼者。在许多任务中,它展示了卓越的性能,甚至超越了一些闭源顶级模型。

总结

Llama 3.1代表了Meta在AI领域的最新进展,不仅在技术性能上取得重大突破,而且通过开放策略推动了整个行业的发展。无论是在学术研究、商业应用还是日常使用中,Llama 3.1都展示了强大的潜力和广泛的适用性。