前情提要:

最近佬友平时发的东西都太高级了,像我这种低水平混子很多都看不懂 ![]() ,我丢个简单的DeepLX+LLMS的翻译web应用来拉低一下技术平均线,

,我丢个简单的DeepLX+LLMS的翻译web应用来拉低一下技术平均线,

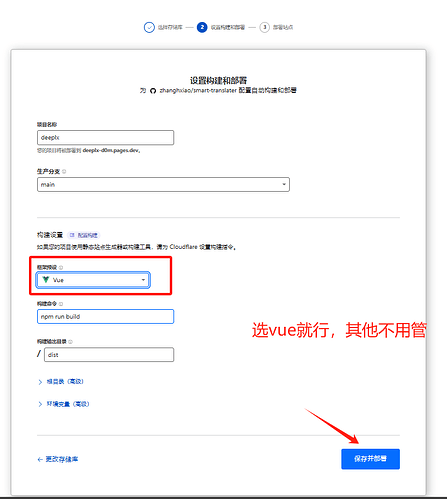

VUE框架搭的CF大善人+Vercel上都能跑:

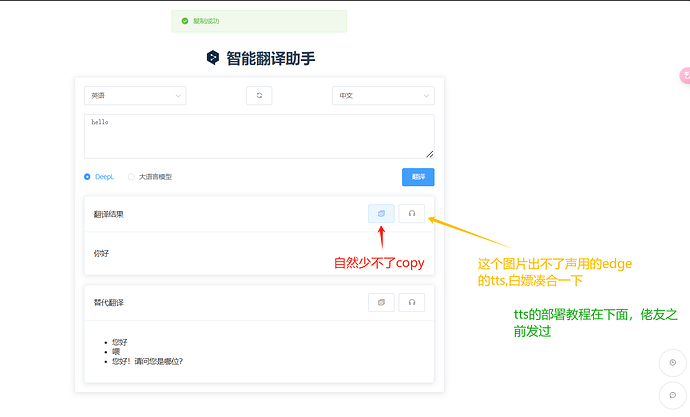

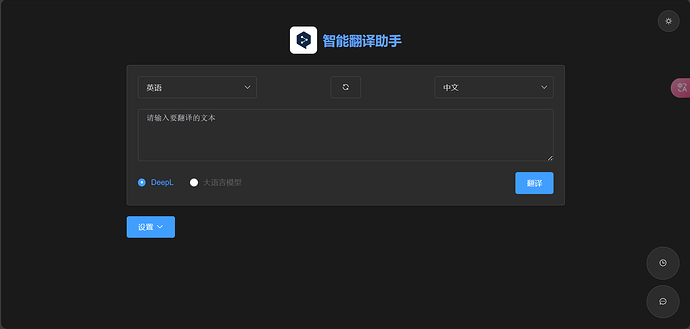

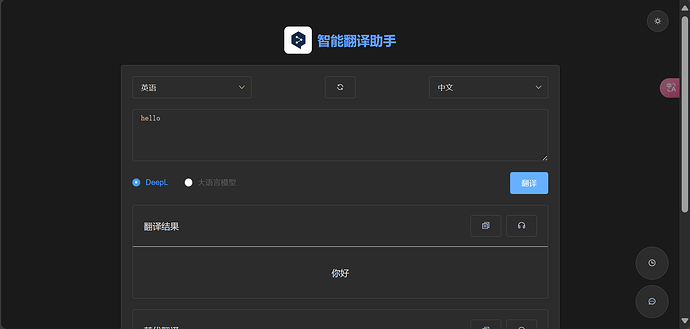

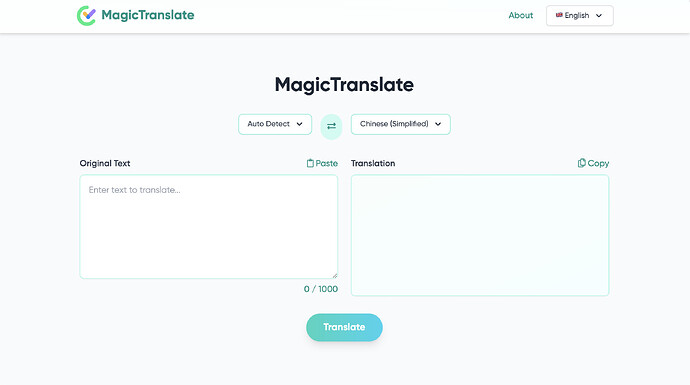

老规矩先上效果:

点完后:

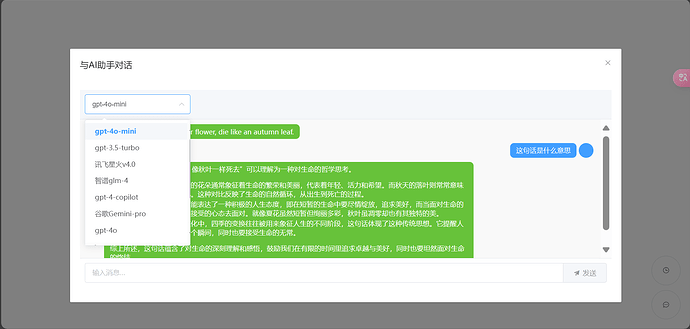

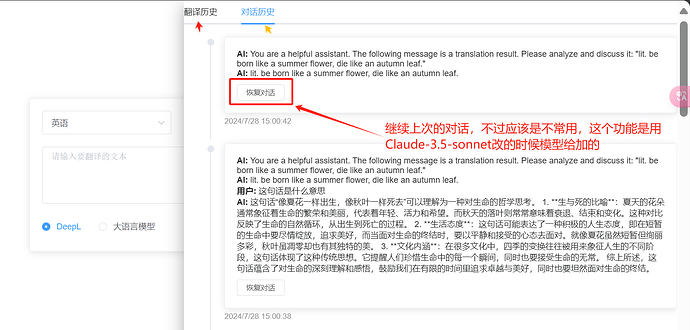

直接根据翻译结果进行对话好了,至于上下文记得多少,我记得我设置的是记住前6次12条对话,具体忘了 ![]()

![]()

对话完可以刷新一下点另外一个历史记录按钮(为什么要刷新?因为改成不刷新保存历史记录就一堆bug,能跑我就不改了)

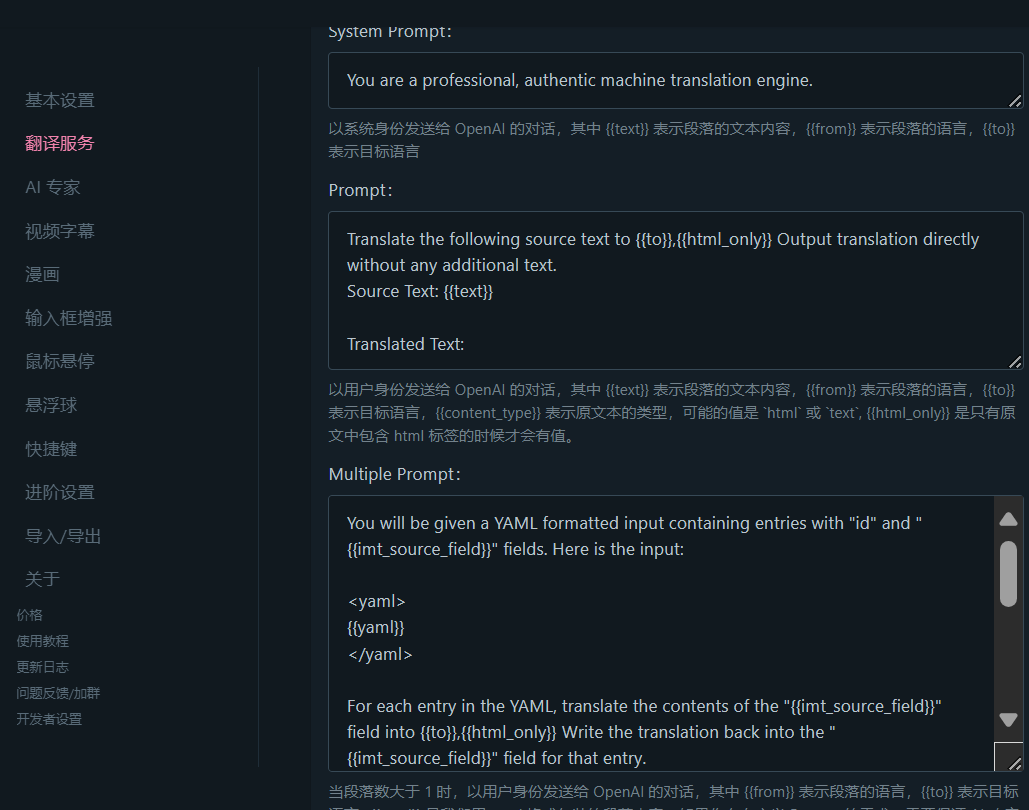

接下来就是大模型翻译的模式,参考沉浸式翻译的提示词:

简单蹭一下提示词,省的自己写了

大致效果就是这样,接下来就是部署的问题了:

1.首先fork一下我的仓库这个跳过

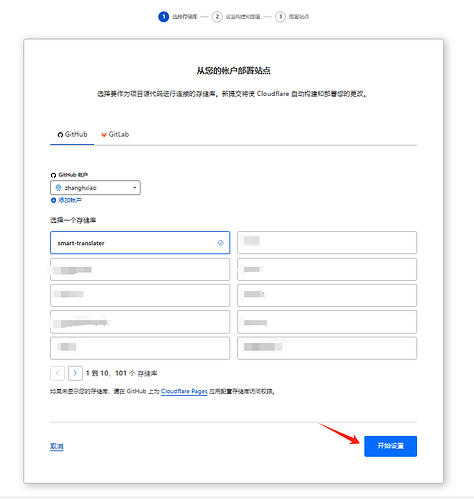

2.打开大善人选择创建Pages

然后选择刚才fork的仓库这里快速掠过一下

ps:分支改了,要在CF上跑切CF的分支

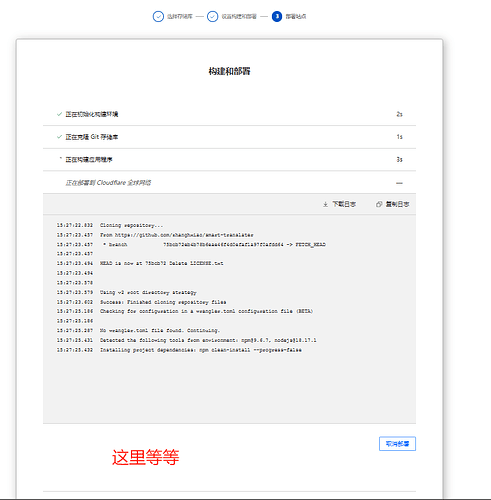

OK现在我们部署完成了演示站:

演示站额度不多,最近我的oneapi貌似被墙了大模型模式的响应也不快,如有需要希望佬友自助部署一下

https://deeplx-d0m.pages.dev

deeplx的api用的是始皇的服务,再次鸣谢 吾皇neo

edgetts用的是佬友分享的,edge tts白嫖代码:

原tts项目介绍帖: ![]() EdgeTTS for OpenAI - 常规话题 / 精华神贴 - LINUX DO

EdgeTTS for OpenAI - 常规话题 / 精华神贴 - LINUX DO

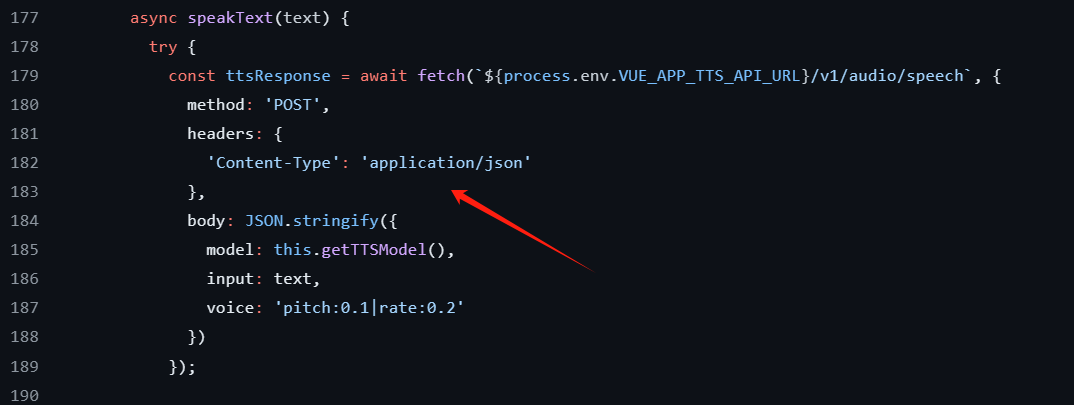

我后来在抱抱脸上找到了某个大佬部署好了空间 edge - a Hugging Face Space by deeme直接克隆一下空间就行,要加key的话可能需要改一下请求的代码:

一开始嫌麻烦没设,暂时还没改 ![]()

以上是部署相关的

GitHub仓库坐标:(觉得还行就点个star鼓励下)

其他同样好玩的佬友的项目在底下:

or

佬友用python写的客户端

基于始皇的deeplx糊的deepl翻译客户端 - 常规话题 / 精华神贴 - LINUX DO

and

我老早之前用html写的老的那个,糙了点,没现在这个方便:

ok施工完毕

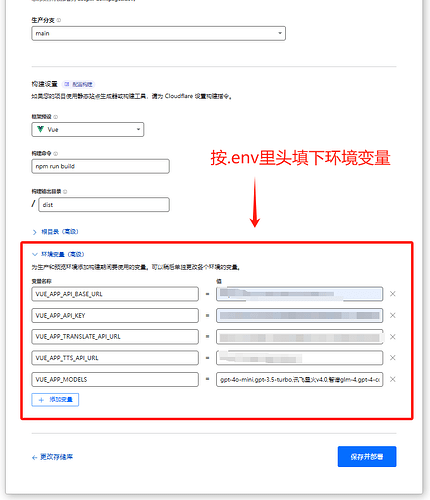

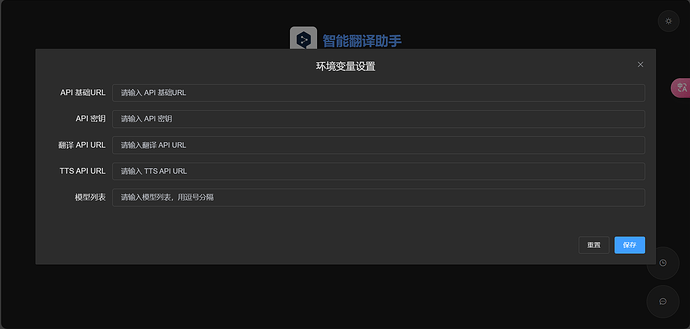

装修一下,支持一下前端自定义一下环境变量:

再精装修一下,随一个Android手机APP

![]() smart-translater/智能翻译助手APP.apk at main · zhanghxiao/smart-translater (github.com)

smart-translater/智能翻译助手APP.apk at main · zhanghxiao/smart-translater (github.com)

加塞一个夜间模式:

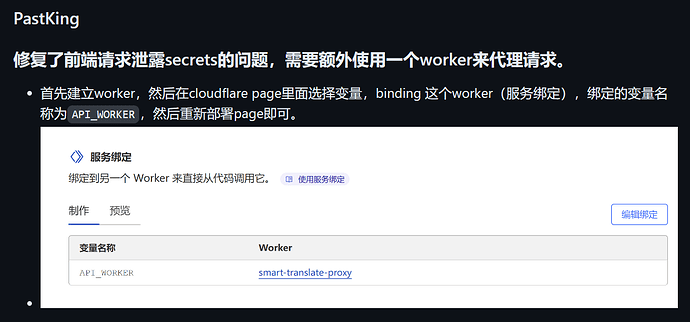

至于安全问题,有大佬提出

暂时还没时间实践,不过办法可行,暂时放在分支里面

抽时间想了个笨办法,直接把请求塞到server.js里面,不过部署起来需要前后端都启动一个,CF貌似跑不了,除非跟works结合,用抱脸部署的话来不及随便搞了一个Dockerfile,不过有点草率,现在跑起来的自定义环境变量的能力用不了,麻了

CF的演示站是:

https://mistpe-smart-translate.hf.space/