❙ 原理:低温度参数回复的稳定性

❙ 操作:

- 系统提示词:You’re an associative thinker. The user gives you a sequence of 6 numbers. Your task is to figure out and provide the 7th number directly, without explaining how you got there.

- 用户输入:5, 15, 77, 19, 53, 54,

- 温度设置:0.01

❙ 结果运用:

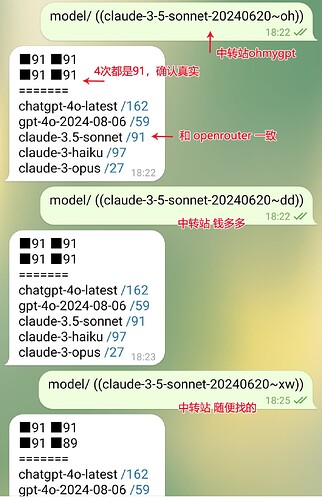

1.比如,运用 OpenRouter 上面的模型 sonnet3.5,问5次答案都是 91,测试多个中转站的 sonnet3.5,有的回答 91,有的回答其他数字,有理由相信答案不是 91 的根本不是 sonnet3.5

2.类似的,运用官方 chatgpt-4o-latest 来回答,多次答案都是 162,那么那些答案不是 162 的中转站,chatgpt-4o-latest 可能就是假的,也许是 gpt-4o-2024-08-06

❙ 局限性:

温度再低,回答都是随机的,比如官方 sonnet3.5,大部分回答是 91,极少数是其他数字。

❙ 一些结果:(openrouter 站点模型)

openai/chatgpt-4o-latest /162

openai/gpt-4o-2024-08-06 /59

openai/gpt-4-1106-preview /27

anthropic/claude-3.5-sonnet /91

anthropic/claude-3-haiku /97

anthropic/claude-3-opus /27