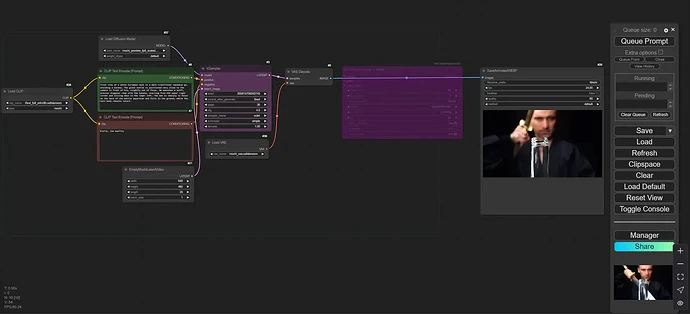

Mochi 视频生成模型现支持 3060 显卡运行

ComfyUI 在 v0.2.7 版本中已原生支持 Mochi 模型,但仍需 4090 显卡才能运行。现在,Mochi 有一个多合一的 fp8 checkpoint,仅需 12GB VRAM 即可运行。要知道,Mochi 刚推出时需要 4 张 H100,如今消费级显卡也能轻松驾驭,开源万岁呀。

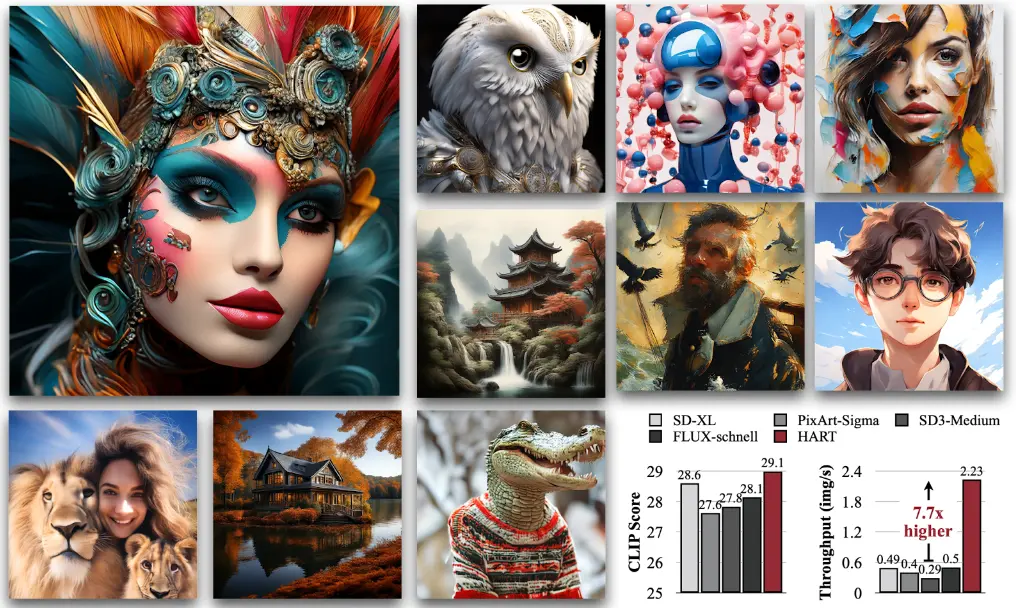

英伟达 HART:速度提升 4.5-7.7 倍的图像生成模型

HART 是英伟达推出的自回归(AR)图像生成模型,能够生成 1024x1024 的高质量图像,其生成速度比扩散模型快 4.5 至 7.7 倍。与 SDXL 相比,HART 在所有基准测试中表现更佳,速度更快。我挺看好这个模型的,速度实在太快了,你们可以在线试用感受一下。

字节跳动推出 X-Portrait 2:表情同步克隆技术再升级

X-Portrait 2 是基于 X-Portrait 的升级版。用户只需提供一张照片和一个视频,即可将视频中的表情同步克隆到照片上。此次更新不仅支持噘嘴、嘟嘴、鼓腮帮子和皱眉等微表情,还能准确还原头部运动和情感。从官方演示来看,X-Portrait 2 的效果远超 Runyway Act-One,尤其是在大幅度变化和动作上,表现得非常自然流畅。目前,该项目仅发布了一个网站,没开源也没论文或在线演示。

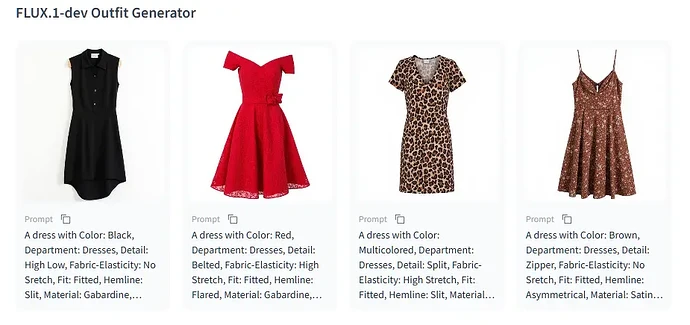

FLUX.1-dev 服装生成 LoRA

Outfit Generator 是 FLUX.1-dev 生态下的 LoRA 模型,它能够通过提示词生成复杂的服装设计,包括颜色、图案、样式、材料和类型等细节。好久没介绍 LoRA 了,这个看着挺不错,你们可以试试。