如题,本地私有化qwen大模型,对接dify 做复杂的任务编排,知识库、sql查询等复杂操作。 dify 对接 openwebui 做前端,这样可以实现吗? 因为openwebui 方便管理用户。 是否支持这样干呢?

14 个赞

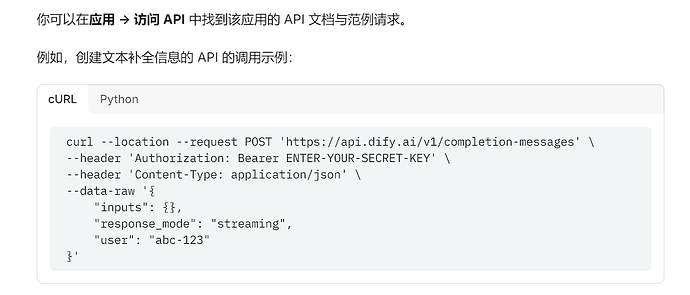

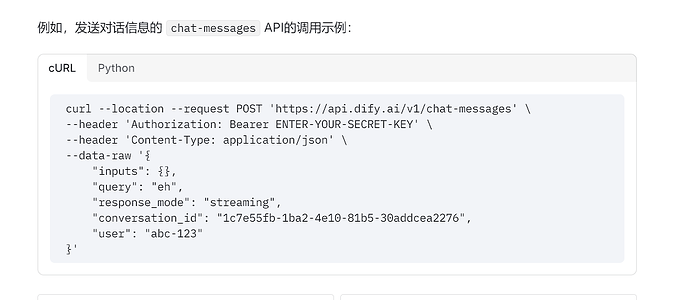

我记得dify的工作流可以发布api,可以看看dify的api接口是不是openai的格式,感觉是可行的

不过从发起请求,到最终openwebui显示出第一个字,会有较长的等待时间

(只是之前用过几次,后来没怎么用过dify)

3 个赞

通过newopen中转下,可以的

2 个赞

看了你另一个帖子,刚测试了下可以实现了。 谢谢大佬。

1 个赞

谢谢! newapi 搞定了

1 个赞

好想法诶

1 个赞

hhhh。。。 给老板们省点银子。

1 个赞

之前没想过这个,一直都是在dify上做workflow,前端展示也是dify,这样说起来就能结合各种好用的前端了

1 个赞

是的,我目前测了三个,openwebui chatgpt-web、lobechat,完美适配。

1 个赞

我试过,转来转去,响应还是挺慢的

1 个赞

大佬本地的模型是哪个模型?用的什么配置?

1 个赞

Open WebUI 的 Pipelines

1 个赞

现在 deepseek 8b实验环境,跑通了 就上A100

1 个赞

如果要做个人 ai 应用的话,用 dify 做知识库和模型维护,是还要一层后端服务做用户系统+访问 dify 接口,然后再返回给前端吗,有更简单的步骤吗…

1 个赞

如果已经有接口了,前端应该怎么做呢?大佬指导下

1 个赞