闲来无事,尝试在手机上部署deepseek r1

用 fullmoon 安装,科学上网后能下载模型,但是进度走到一半就不动了

用 pockedpal 能正常下载安装运行,就是上下文太短了

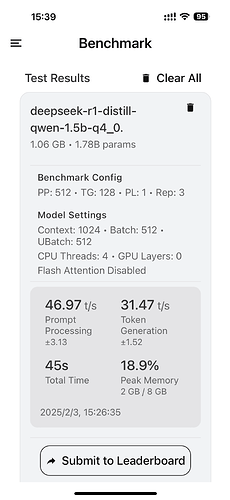

测了一下1.5b 的 benchmark,结果如下图。

其实我想问的是哪个模型最合适在手机上运行?

这也可以 ![]()

先烧电池 ![]()

1.5b最多了

7b估计也能吧

![]() , 不如嫖API直接用.

, 不如嫖API直接用.

手机上跑模型多少有点搞笑了

吓得我马上进来看看。

手机上目前我跑最好的是MiniCPM,其他的不太行。

1 个赞

手机部署用的是内存吗?

手机部署的能用显卡加速啥的吗

7b能跑,我最高跑到9b。目前在用Qwen2.5-7B,速度算可用。