原来有这么多

openwebui确实舒服点

看ollama的readme,发现这里也收集了好多第三方的ui![]()

刚去搭建了这个,UI确实很不错

1 个赞

搭好了,才发现官方给的可配置项还不少,之前没细看还以为不支持

open-webui环境变量

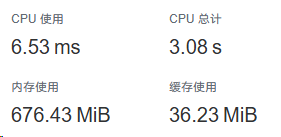

界面确实舒服,还能一次问多个模型,就是这内存占用和其他项目比大好多 ![]()

贴个docker-compose配置,可以参考

services:

open-webui:

image: ghcr.io/open-webui/open-webui:${WEBUI_DOCKER_TAG-main}

container_name: open-webui

volumes:

- ./data:/app/backend/data

ports:

- 8080:8080

environment:

- 'WEBUI_SECRET_KEY='

# openai 配置

- 'OPENAI_API_BASE_URL=http://new-api:3000/v1'

- 'OPENAI_API_KEY=sk-xxx'

# 启用openai画图

- 'ENABLE_IMAGE_GENERATION=true'

- 'IMAGE_GENERATION_ENGINE=openai'

# 关闭登录功能

- 'WEBUI_AUTH=false'

# 忽略部分模型

- 'ENABLE_MODEL_FILTER=true'

- 'MODEL_FILTER_LIST=tts-az-1;tts-1'

restart: unless-stopped

9 个赞

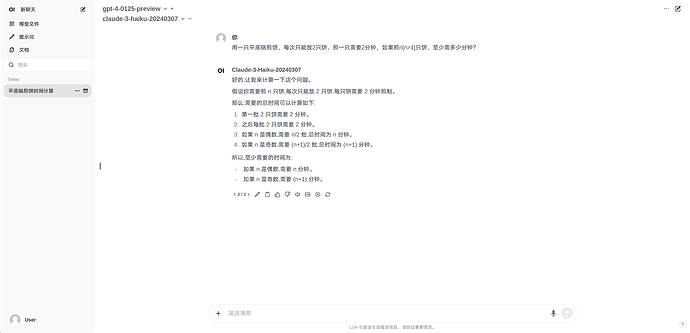

确实多,以前都没发现,不过有些是纯软件的,通用的WebUI大致也就那些 ![]()

个人感觉librechat是里面用着最舒服的,而且自定义程度很高,可以自己适配站点,主打一个优雅,并且支持所有模型的rag和分叉树,而且看官网说插件功能会在今年暑期迎来重构预计支持所有模型。

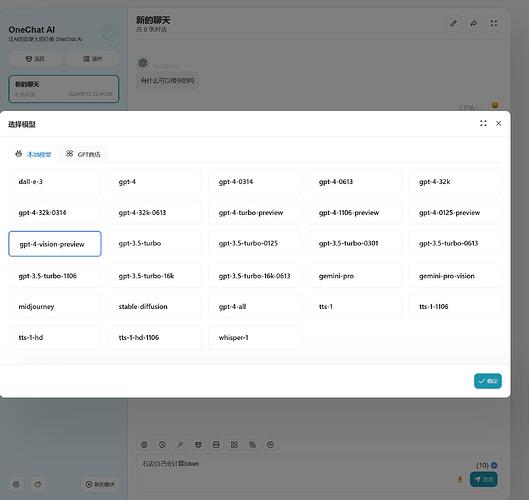

楼主感觉libre和openweb哪个更好点 ![]()

最后一个的看着也不错呀

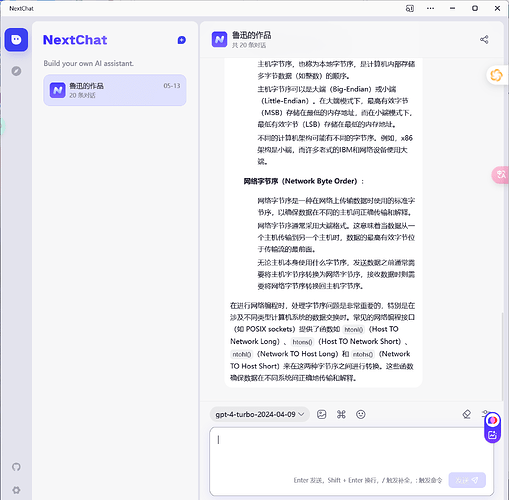

nextchat用了蛮久 很方便 也算简约

不在意内存的话感觉openwebui好点,我是打算先换这个了,后面有其他的再说

1 个赞

这个能只使用gpt吗,我感觉一部署下载一堆东西就得

1 个赞

官方是只支持openai和ollama,用 one-api/new-api 可以支持其他模型,这个Docker镜像3G多来着挺大的

好家伙 算了,果断使用librechat

mark

试试这个:GitHub - vercel/ai-chatbot: A full-featured, hackable Next.js AI chatbot built by Vercel 绝对舒服和轻便。

这玩意怎么啥都没有,没有模型选择,没有余额,没有充值口,就直接使用?