三花 AI 一觉醒来发生了什么?欢迎阅读![]()

![]() ReHiFace-S:硅基智能开源的实时换脸项目

ReHiFace-S:硅基智能开源的实时换脸项目

![]() Haystack:基于图的全新交互代码编辑器

Haystack:基于图的全新交互代码编辑器

![]() Anthropic:提示工程从入门到精通

Anthropic:提示工程从入门到精通

![]() Cursor AI Rules 提示词库

Cursor AI Rules 提示词库

![]() 快手:可图虚拟试衣项目

快手:可图虚拟试衣项目

![]() Chrome 内置 Google Lens 和 Gemini

Chrome 内置 Google Lens 和 Gemini

![]() 马斯克 Grok2 超越 GPT-4o

马斯克 Grok2 超越 GPT-4o

![]() AiM:首个基于 Mamba 的图片生成模型

AiM:首个基于 Mamba 的图片生成模型

![]() Meta sapiens:全新以人为中心的视觉模型

Meta sapiens:全新以人为中心的视觉模型

![]() VideoSys:实时视频生成技术

VideoSys:实时视频生成技术

ReHiFace-S:硅基智能开源的实时换脸项目

ReHiFace-S 又一个实时换脸项目,只需一张照片就能将视频中的人脸实时替换。

官方宣称无需高性能显卡,只需要 GTX 1080Ti 就能进行高保真的实时换脸。所有需要的模型加起来 842MB,内置 Gradio 界面,还非常贴心的提供了百度云的下载地址…

不过似乎真实运行效果一般,Readme 提供的 Demo 更像是 deepfacelive 出来的效果,但官方没人回应。

Haystack:基于图的全新交互代码编辑器

最近 Cursor 编辑器打的 Github Copilot 抬不起头,最近又出来一个新的编辑器,Haystack,一样是基于 VSCode,只不过彻底改了交互方式,不在局限于传统的 Tab 而是类似流程图那样,直接将所有代码摆在画布中。

我简单测试了一下,同样支持 AI,也能一键从 VSCode 导入插件,交互非常的新奇和不适,能可视化不同文件的关系,非常酷的方式,建议没事干的时候玩一下,需要一段时间来适应…

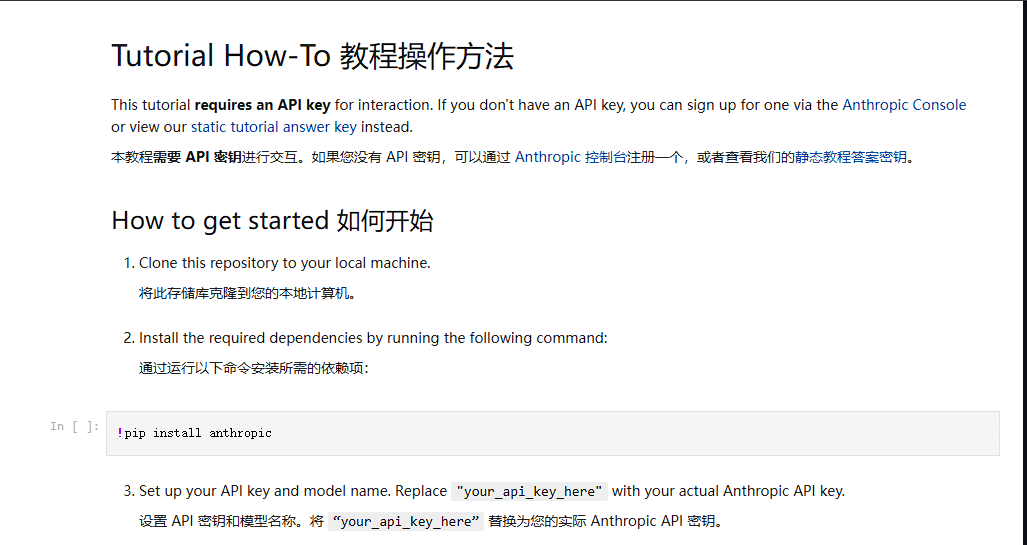

Anthropic:从入门到精通交互式提示工程教程

由 Anthropic 官方推出的系列教程,皆在让人们能轻松设计适用于 Claude 的最佳提示词。

提供了基础、入门、进阶的教程,全部是由 Jupyter Notebook 写的,需要 PY 环境。

直达:Prompt Engineering Interactive Tutorial

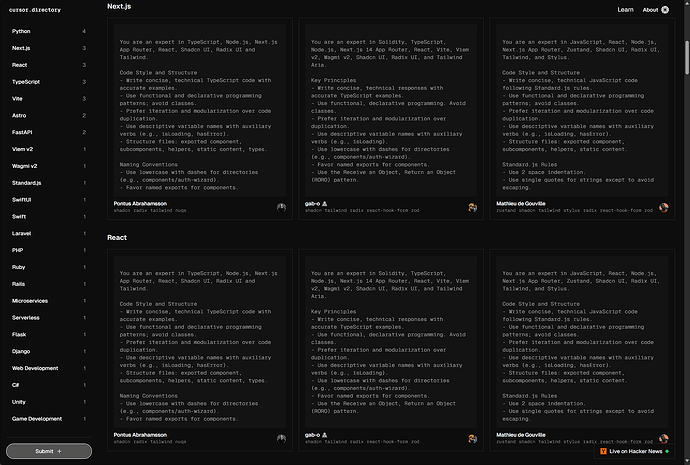

Cursor AI Rules 提示词库

我们知道 Cursor 有非常方便的 Chat 和 CMD+k 功能,对于不同技术栈的项目还可以通过 .cursorrules 文件指定其 “AI 规则”。

有人整理了适用于 Cursor 的不同语言和项目的 Rules,非常方便的复制粘贴到 .cursorrules 文件中即可。

快手可图虚拟试衣

Kwai-Kolors/Kolors-Virtual-Try-On 是快手推出全新虚拟试穿演示,选择人物,上传服装即可生成非常自然的试穿效果。

可惜的是,虽然打着 Kolors 的旗号但是模型和代码并没有开源,而且官方人员也表示暂时不会。

截至到目前,因为用的人太多,这个 Space 暂不可用,不过可以先收藏,等快手修复。

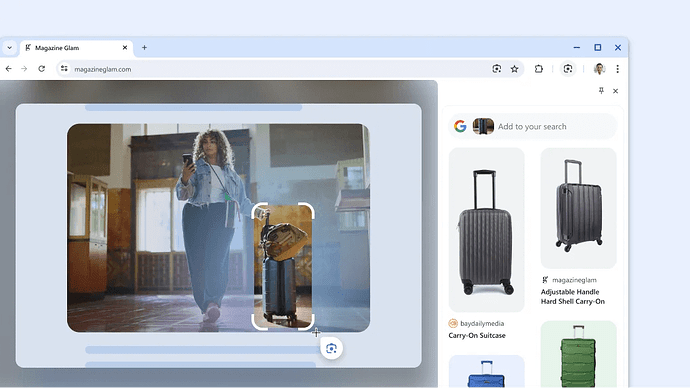

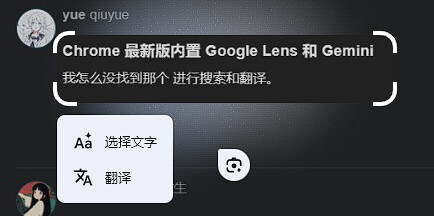

Chrome 最新版内置 Google Lens 和 Gemini

如果你用过谷歌的搜图功能或 Pixel 系列手机,那么对这个功能不会陌生,现在 Chrome 也内置了该功能,通过框选网页上的任何东西都可以进行搜索和翻译。

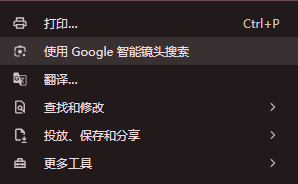

你可以自己试试,就在右上角三个点里,支持中文,功能的话目前只有搜图和翻译功能。

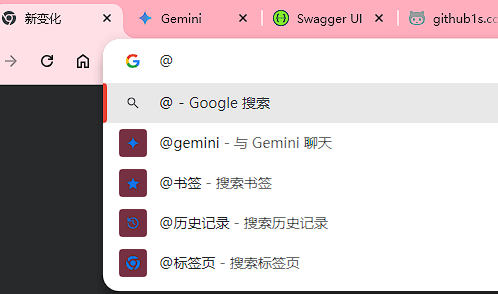

除此之外,现在可以直接在地址栏输入 @gemini promt 来自动跳转到 Gemini 官方并聊天。

算是很保守的植入方式了,另外这是我第一次知道可以用 @ 搜索历史记录、书签和已经打开的网页,学到了。

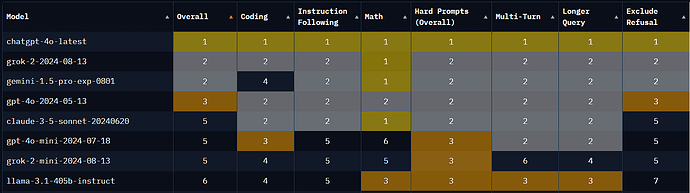

马斯克 Grok2 超越 GPT-4o

老马家的最新的 grok-2-2024-08-13 现在在 Chatbot Arena 排行榜上已经超过 gpt-4o 和 gemini-1.5pro,如果你有订阅 X 的会员可以直接用上。

感觉现在发布大模型不超越 gpt4 都不好意思发布。

AiM:首个基于 Mamba 的图片生成模型

AiM 是首个基于 Mamba 的自回归图像生成模型,与 diffusion 模型同质量下拥有更快的速度。

现在项目还很早期,想与 diffusion 模型竞争的话任重而道远。

Meta sapiens:全新以人为中心的视觉模型

“真 Open” 的 Meta 开源了他们的 Sapiens 模型,一个专门用来识别人的模型,包括:

-

2D 姿态估计(识别人身体的姿势)

-

身体部位分割(区分身体的各个部分)

-

深度估计(确定物体距离的远近)

-

表面法线预测(判断物体表面的方向)

我愿再称小札为赛博佛祖!可以预知,很快就会有相关的 ControlNet 预处理器出现了!

VideoSys:实时视频生成技术

VideoSys 的 Pyramid Attention Broadcast (PAB),这是首个实现基于扩散模型(DiT)的实时视频生成技术。

PAB 在不损失质量的前提下,在 8 块 H100 上实现了高达 21.6 帧每秒的视频生成速度,这项技术适用于包括 Open-Sora、Open-Sora-Plan 和 Latte 在内的多种流行的 DiT 视频生成模型。

最关键的是,这是一种无需训练的方法,PAB 能为任何 DiT 视频生成模型赋予实时生成的能力。

注意,对比视频中,左边是 1 块 H100,右边是 8 块。