我的安装命令:

docker run -d -p 3000:8080 -v ollama:/root/.ollama -v open-webui:/app/backend/data --name open-webui --restart always ghcr.io/open-webui/open-webui:ollama

安装完成后 docker ps信息:

ghcr.io/open-webui/open-webui:ollama "bash start.sh" 41 minutes ago Up 35 minutes (healthy) 0.0.0.0:3000->8080/tcp, [::]:3000->8080/tcp open-webui

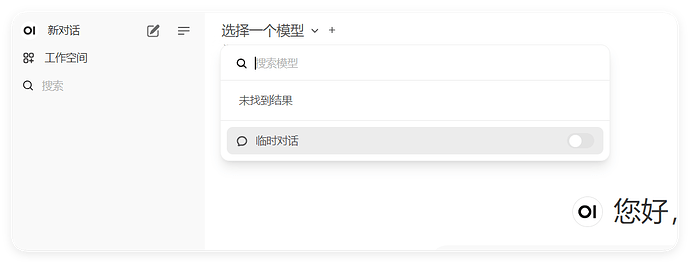

安装完之后open webui截图:

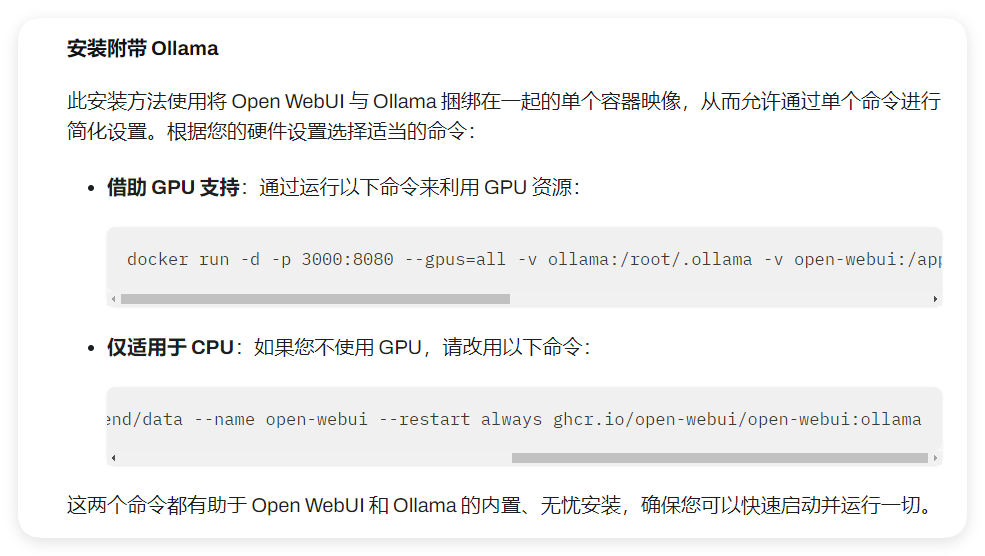

官方教程:

通过这个命令官方不是说 Ollama内置的吗,为啥我这安装完之后没有这个模型呢,有部署过的大佬可以帮忙给个答案吗