在原帖的基础上,支持图片多比例,优化出图格式,支持联网,优化图生图,优化识图。

首先感谢原帖大佬

【Fastgpt系列3】一分钱不花 集最先进的大语言模型与绘画模型于一身,openwebui替代升级版,可接入NEW API或ONE API,永久免费 - 资源荟萃 - LINUX DO

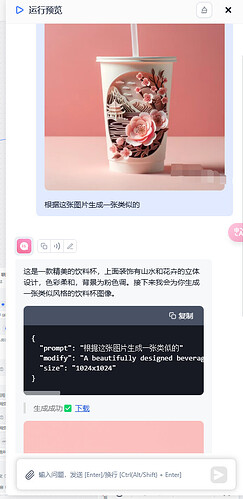

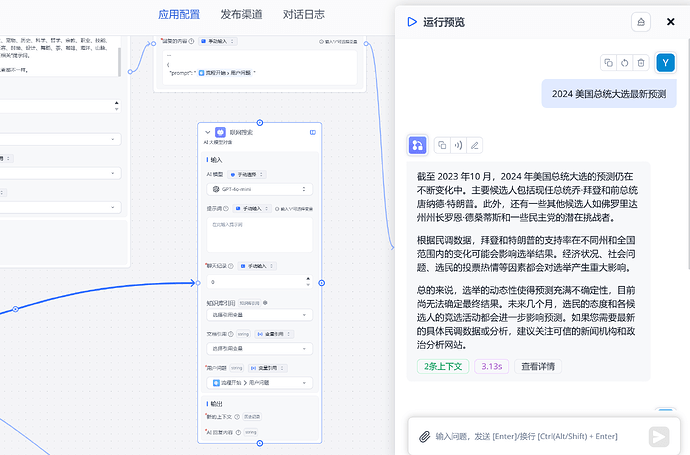

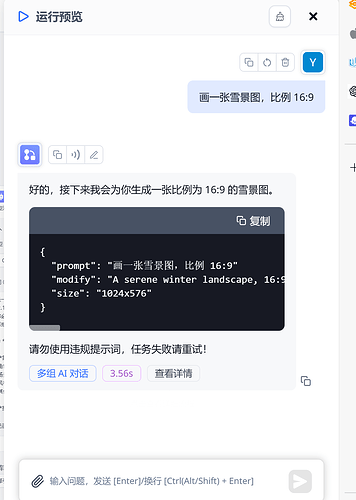

效果展示

废话不多说直接上效果

完整文字演示

Role: Human

画一只小猫咪,图片比例16:9

Role: AI

好的,接下来我会为你生成一只小猫咪的图像,比例为16:9。

{

"prompt": "画一只小猫咪,图片比例16:9"

"modify": "A cute kitten sitting playfully on a soft blanket, with big sparkling eyes and fluffy fur, in a cozy room filled with warm sunlight. The background features a few colorful toys scattered around, creating a cheerful atmosphere. The image is in a 16:9 aspect ratio, capturing the adorable essence of the kitten in a vibrant and inviting setting."

"size": "1024x576"

}

生成成功

下载

这是一只可爱的小猫,悠然自得地坐在柔软的毯子上,闪亮的大眼睛和毛茸茸的皮毛增添了活泼气息,房间充满温暖的阳光,背景中散落着几件彩色玩具,营造出愉悦的氛围。

Role: Human

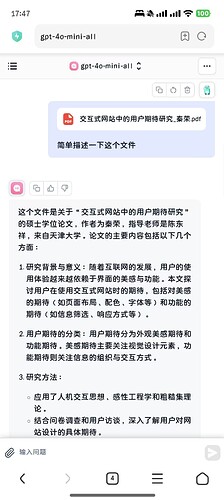

,简单描述一下这个文件

Role: AI

这个文件是关于“交互式网站中的用户期待研究”的硕士学位论文,作者为秦荣,指导老师是陈东祥,来自天津大学。论文的主要内容包括以下几个方面:

-

研究背景与意义:随着互联网的发展,用户的使用体验越来越依赖于界面的美感与功能。本文探讨用户在使用交互式网站时的期待,包括对美感的期待(如页面布局、配色、字体等)和功能的期待(如信息筛选、响应方式等)。

-

用户期待的分类:用户期待分为外观美感期待和功能期待。美感期待主要关注视觉设计元素,功能期待则关注信息的组织与交互方式。

-

研究方法:

-

应用了人机交互思想、感性工程学和粗糙集理论。

-

结合问卷调查和用户访谈,深入了解用户对网站设计的具体期待。

-

通过数据分析,建立用户模型,指导网页设计。

-

主要结论:设计的成功与否受到能否满足用户期待的影响,强调了在网页设计中融合用户研究的重要性。

-

应用实例:以天大精益数控机床采购网为案例,基于研究结果提出具体的设计建议和效果图,包括网络的布局、功能设计、用户交互等方面。

-

总结与展望:指出未来网页设计趋向于更人性化、感性化,强调继续研究用户需求与网站设计之间的关系。

总体来看,这份论文系统地分析了用户在交互式网站中对设计元素的期待,并提供了理论支持和实践指导。

Role: Human

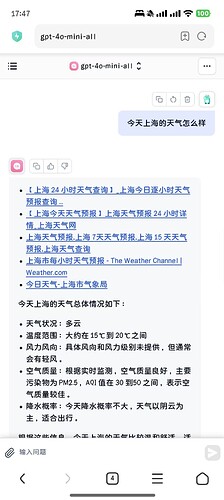

今天上海的天气怎么样

Role: AI

今天上海的天气总体情况如下:

-

天气状况:多云

-

温度范围:大约在15℃到20℃之间

-

风力风向:具体风向和风力级别未提供,但通常会有轻风。

-

空气质量:根据实时监测,空气质量良好,主要污染物为PM2.5,AQI值在30到50之间,表示空气质量较佳。

-

降水概率:今天降水概率不大,天气以阴云为主,适合出行。

根据这些信息,今天上海的天气比较温和舒适,适合进行户外活动。希望这些信息对您有所帮助!

Role: Human

搜索小猫咪

Role: AI

你在寻找与可爱小猫咪相关的内容,这里有一些推荐的资源:

- 视频集锦:

- 超可爱猫猫视频集锦 - 哔哩哔哩:这个视频集锦包含了丰富的可爱猫咪视频,目前播放量超过20531次,汇聚了大量的萌宠镜头。

- 短视频平台:

- 在抖音上,有一个标签为“可爱的小猫咪”,已经获得了超过82.7亿次的观看。你可以通过这个平台探索更多关于小猫咪的短视频:抖音可爱的小猫咪。

- 高清免费视频:

- 如果你想要一些可爱的猫咪视频,可以在 Pixabay 找到超过40000个免版税的可爱小猫视频。这些视频都非常高清,适合不同用途。

- 有趣猫咪合集:

- 还有一个叫做那些有趣可爱的小猫01的合集,播放量高达118303次,包含许多有趣的小猫动作和场景。

以上资源可以帮助你找到更多关于可爱小猫咪的内容,享受这些萌宠带来的乐趣!

Role: Human

你能干些什么

Role: AI

我能为您提供多种服务,包括但不限于以下几方面:

-

信息查询与回答:回答您的问题,包括天气、新闻、科技、文化等各类信息。

-

文本生成:根据您的提示,生成文章、故事、诗歌、报告等文本文档。

-

文章总结与分析:对提供的文章或文档进行总结、分析,提取关键信息。

-

语言翻译:提供多种语言间的实时翻译服务。

-

图像生成:根据描述生成图片或插图(在可用情况下)。

-

建议和推荐:根据您的需求,提供书籍、电影、音乐、旅行等方面的建议。

-

数据处理与分析:帮助解析和分析数据集,提供统计信息或图表。

-

学习辅导:提供学术问题上的帮助和解释,辅导学习相关的技巧和方法。

-

个人助手:帮助您制定计划、提醒事项、管理日程等。

如果您有特定的需求,随时告诉我,我会尽力提供帮助!

教程

这里给出gpt-4o-mini的联网模型Key,由于本人能力有限,每天免费2000次。

联网免费Key

接口:

https://api.flowerfire.org

Key:sk-jizS1e3xQYjHoc5Gxmy9KuGSzXU9Oe4Cl1IOMeaerYrZZFeB

模型:gpt-4o-mini,net-gpt-4o-mini

说明

- 可以将上方接口和key添加到你自己的

one/new api渠道,然后修改fastgpt的docker-compose.yml文件即可;- 或者直接添加本渠道和key到

fastgpt的docker-compose.yml文件,注意fastgpt的接口为https://api.flowerfire.org/v1。

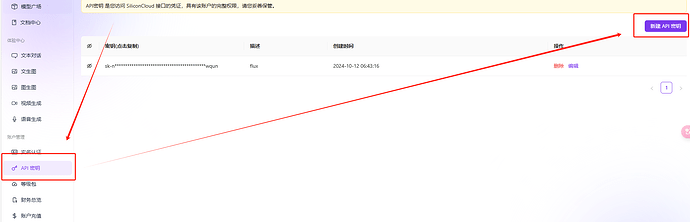

另外需要硅基流动的Flux绘图,可以通过本人 AFF 注册

硅基流动注册

- 邀请好友赚2000万Tokens:每成功邀请一位新用户,好友注册成功,您将获得2000万Tokens;

- 注册即送2000万Tokens:受邀好友作为新用户完成SiliconCloud账号注册,立刻获得2000万Tokens。

Fastgpt的搭建教程就不多说了,官方文档很详细,这里说几点注意事项

Fastgpt的修改

修改config.json,添加模型net-gpt-4o-mini,需要其他模型也可以添加,这里给出我本人的例子。

config.json例子

{

"feConfigs": {

"lafEnv": "https://laf.dev"

},

"systemEnv": {

"vectorMaxProcess": 15,

"qaMaxProcess": 15,

"pgHNSWEfSearch": 100

},

"llmModels": [

{

"model": "gpt-4o-mini",

"name": "gpt-4o-mini",

"avatar": "/imgs/model/openai.svg",

"maxContext": 125000,

"maxResponse": 16000,

"quoteMaxToken": 120000,

"maxTemperature": 1.2,

"charsPointsPrice": 0,

"censor": false,

"vision": true,

"datasetProcess": true,

"usedInClassify": true,

"usedInExtractFields": true,

"usedInToolCall": true,

"usedInQueryExtension": true,

"toolChoice": true,

"functionCall": false,

"customCQPrompt": "",

"customExtractPrompt": "",

"defaultSystemChatPrompt": "",

"defaultConfig": {},

"fieldMap": {}

},

{

"model": "net-gpt-4o-mini",

"name": "net-gpt-4o-mini",

"avatar": "/imgs/model/openai.svg",

"maxContext": 125000,

"maxResponse": 16000,

"quoteMaxToken": 120000,

"maxTemperature": 1.2,

"charsPointsPrice": 0,

"censor": false,

"vision": true,

"datasetProcess": true,

"usedInClassify": true,

"usedInExtractFields": true,

"usedInToolCall": true,

"usedInQueryExtension": true,

"toolChoice": true,

"functionCall": false,

"customCQPrompt": "",

"customExtractPrompt": "",

"defaultSystemChatPrompt": "",

"defaultConfig": {},

"fieldMap": {}

},

{

"model": "gpt-4o",

"name": "gpt-4o",

"avatar": "/imgs/model/openai.svg",

"maxContext": 125000,

"maxResponse": 4000,

"quoteMaxToken": 120000,

"maxTemperature": 1.2,

"charsPointsPrice": 0,

"censor": false,

"vision": true,

"datasetProcess": true,

"usedInClassify": true,

"usedInExtractFields": true,

"usedInToolCall": true,

"usedInQueryExtension": true,

"toolChoice": true,

"functionCall": false,

"customCQPrompt": "",

"customExtractPrompt": "",

"defaultSystemChatPrompt": "",

"defaultConfig": {},

"fieldMap": {}

},

{

"model": "dall-e-3",

"name": "dall-e-3",

"avatar": "/imgs/model/openai.svg",

"maxContext": 125000,

"maxResponse": 4000,

"quoteMaxToken": 120000,

"maxTemperature": 1.2,

"charsPointsPrice": 0,

"censor": false,

"vision": true,

"datasetProcess": true,

"usedInClassify": true,

"usedInExtractFields": true,

"usedInToolCall": true,

"usedInQueryExtension": true,

"toolChoice": true,

"functionCall": false,

"customCQPrompt": "",

"customExtractPrompt": "",

"defaultSystemChatPrompt": "",

"defaultConfig": {},

"fieldMap": {}

},

{

"model": "o1-mini",

"name": "o1-mini",

"avatar": "/imgs/model/openai.svg",

"maxContext": 125000,

"maxResponse": 65000,

"quoteMaxToken": 120000,

"maxTemperature": 1.2,

"charsPointsPrice": 0,

"censor": false,

"vision": false,

"datasetProcess": true,

"usedInClassify": true,

"usedInExtractFields": true,

"usedInToolCall": true,

"usedInQueryExtension": true,

"toolChoice": false,

"functionCall": false,

"customCQPrompt": "",

"customExtractPrompt": "",

"defaultSystemChatPrompt": "",

"defaultConfig": {

"temperature": 1,

"stream": false

},

"fieldMap": {

"max_tokens": "max_completion_tokens"

}

},

{

"model": "o1-preview",

"name": "o1-preview",

"avatar": "/imgs/model/openai.svg",

"maxContext": 125000,

"maxResponse": 32000,

"quoteMaxToken": 120000,

"maxTemperature": 1.2,

"charsPointsPrice": 0,

"censor": false,

"vision": false,

"datasetProcess": true,

"usedInClassify": true,

"usedInExtractFields": true,

"usedInToolCall": true,

"usedInQueryExtension": true,

"toolChoice": false,

"functionCall": false,

"customCQPrompt": "",

"customExtractPrompt": "",

"defaultSystemChatPrompt": "",

"defaultConfig": {

"temperature": 1,

"stream": false

},

"fieldMap": {

"max_tokens": "max_completion_tokens"

}

}

],

"vectorModels": [

{

"model": "text-embedding-ada-002",

"name": "Embedding-2",

"avatar": "/imgs/model/openai.svg",

"charsPointsPrice": 0,

"defaultToken": 700,

"maxToken": 3000,

"weight": 100,

"defaultConfig": {},

"dbConfig": {},

"queryConfig": {}

},

{

"model": "text-embedding-3-large",

"name": "text-embedding-3-large",

"avatar": "/imgs/model/openai.svg",

"charsPointsPrice": 0,

"defaultToken": 512,

"maxToken": 3000,

"weight": 100,

"defaultConfig": {

"dimensions": 1024

}

},

{

"model": "text-embedding-3-small",

"name": "text-embedding-3-small",

"avatar": "/imgs/model/openai.svg",

"charsPointsPrice": 0,

"defaultToken": 512,

"maxToken": 3000,

"weight": 100

}

],

"reRankModels": [],

"audioSpeechModels": [

{

"model": "tts-1",

"name": "OpenAI TTS1",

"charsPointsPrice": 0,

"voices": [

{ "label": "Alloy", "value": "alloy", "bufferId": "openai-Alloy" },

{ "label": "Echo", "value": "echo", "bufferId": "openai-Echo" },

{ "label": "Fable", "value": "fable", "bufferId": "openai-Fable" },

{ "label": "Onyx", "value": "onyx", "bufferId": "openai-Onyx" },

{ "label": "Nova", "value": "nova", "bufferId": "openai-Nova" },

{ "label": "Shimmer", "value": "shimmer", "bufferId": "openai-Shimmer" }

]

}

],

"whisperModel": {

"model": "whisper-1",

"name": "Whisper1",

"charsPointsPrice": 0

}

}

另外需要修改docker-compose中的接口,可以自己添加渠道或者直接填写本人的免费key,上面有说明。

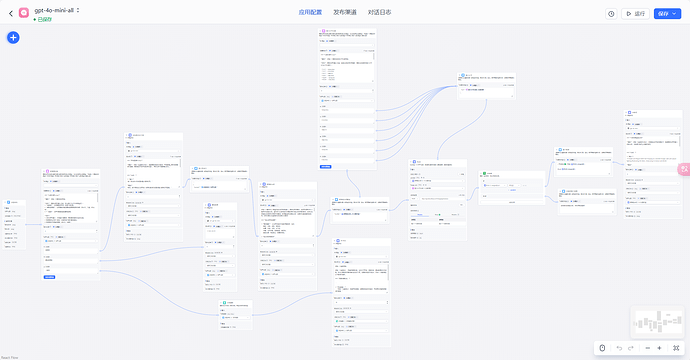

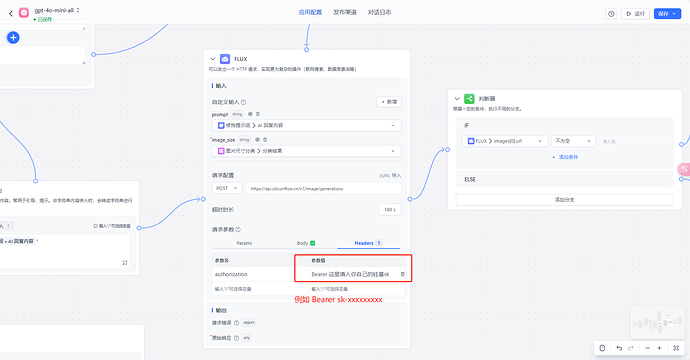

导入工作流

首先创建工作流

然后导入以下配置

创建自己的硅基流动Key并且填写

右上角保存后即可直接对话,或者发布渠道,可自行对接 one/new api 等。

制作不易,感谢点赞。

后续完善图生图与识图

后面简单修改了一下,因为gpt-4o-mini本身是支持识图的,所以完善图生图

支持图生图 / 支持识图

可能提示词需要修改,大家可以自行看一看

支持图生图工作流分享

gpt-4o-mini-all.txt (71.8 KB)

注意事项

- 如果搜索不了,直接明确说明搜索二字,用我提供的或者自己添加自己的联网模型,去

config.json填写自定义模型,记得在自己的中转添加; - 记得填自己的硅基流动Key,出问题可以看工作流过程详情;

- 可能有些渠道的

gpt-4o-mini不支持识图; - 如果你有自己的联网模型或者识图模型,比如

glm的,或者千问的,可以不用我提供的; - 图生图回答可能偶尔出现回答不对头的情况,可以自行优化提示词;

- 提示词是用

claude和gpt优化写的,大家可以根据自己的需求进行优化。