请教一下,中文的嵌入模型,有比这个bge-m3更好的模型吗?

英文的话,是不是openAI的最好?

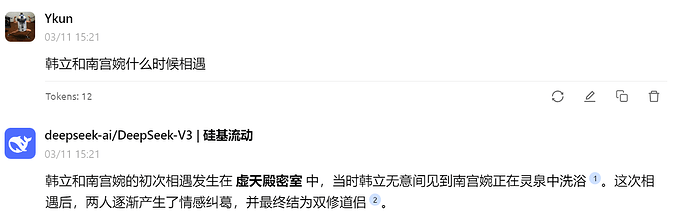

这个没怎么玩过,想梳理一下时间线才想着玩玩的,还是和以前一样效果不太好,站内有其他佬的方案,可以去看看,这边单纯发出来看看 ![]()

南宫婉已经被遗忘了 ![]()

BGE-M3就是最好的嵌入模型,术业有专攻,它就是专家

英文的嵌入模型有什么推荐吗? 我用cherry,调用硅基的BGE-M3建立一些英文文档作为知识库,感觉搜索不是特别准确。

BGE的最佳拍档是Dify中的知识库

目前最好的可能是gemini-embedding-exp-03-07吧,不過這東西額度太少根本用不了,RPM只有5,max_tokens是8192,8192*5也只有40960tokens,這個額度連一個網頁都讀不了

![]() 我就说这玩意咋半天不动呢

我就说这玩意咋半天不动呢

我现在英文文档就丢google的notebooklm,感觉也挺好用。就是公司网络是澳门出口的,用不了notebooklm,只能在家看,不太方便 ![]()

好的,我回头试试Dify

fastgpt 也可以试试

cherry studio的rag就只是简简单单的向量搜索罢了,没有整体性的理解能力。

要做梳理,做总结概况等之类的篇幅较大的内容,看微软的项目:GitHub - microsoft/graphrag: A modular graph-based Retrieval-Augmented Generation (RAG) system

纯文本信息,结构看起来也挺规整的,还是说文本的结构他都解析不出来,不应该把人名也能检索错吧。

感谢,我也看看这个

看到这句话有点害怕的样子,大佬有部署过吗?请问是非常消耗本地算力,还是需要耗费大量token。

用 ds v3,你可以用火山免费,也可以找找其它便宜的渠道,找不到便宜的渠道可以看看我自己的站。

整体耗费的tokens主要是在准备上,后续使用的时候耗费的tokens差不多。

根据你的数据量,再怎么多也不会过几百,再多就不是你个人玩得转的了。